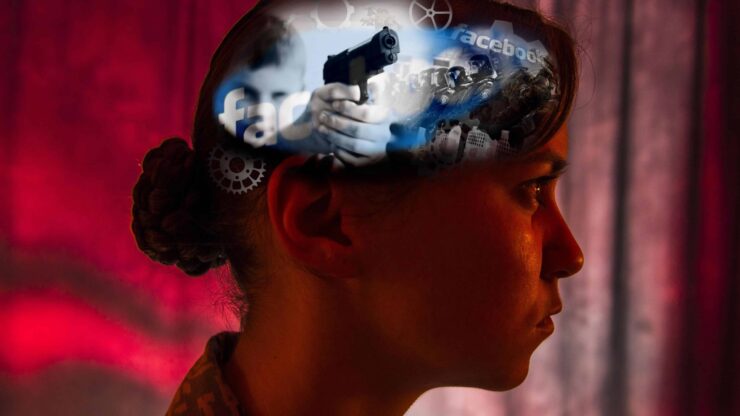

Det er jo egentlig helt utrolig: Facebook er et nettverk med milliarder av brukere, og likevel skjer det så å si aldri at du åpner appen og får en drapsvideo eller ett eller annet hardpornografisk i fleisen.

Mange tror sikkert det er et resultat av sinnsrike filtre, bildegjenkjenning og den beste kunstige intelligensen som kan kjøpes for penger. I virkeligheten er Facebook (såvel som Twitter og Youtube) fortsatt avhengige av høyst menneskelig arbeidskraft for å luke ut støtende innhold.

Det betyr akkurat det det høres ut som: Det sitter folk – titusener av folk – og klikker seg gjennom alle poster og annonser som noen har reagert på og rapportert inn. Det for å avgjøre om materialet i hvert enkelt tilfelle er uproblematisk eller om det skal merkes, begrenses i utbredelse eller fjernes helt.

Disse moderator-sentrene ble ført kjent for alvor gjennom en reportasje fra Filippinene i Wired i 2014, er siden da etablert mange andre steder i verden og omhyllet av et voldsomt hemmelighetskremmeri.

Men det amerikanske teknologinettstedet The Verge (en del av Vox Media-konsernet, som står bak mye god og etterrettelig journalistikk) har i en stor reportasje fått flere ansatte og tidligere ansatte til å snakke om sine erfaringer som Facebook- og Instagram-moderatorer.

Det har resultert i en oppsiktsvekkende og til dels forstyrrende reportasje. Her er fem lærdommer alle Facebook-brukere bør ha interesse av å kjenne til.